Token即货币,AaaS模式崛起:英伟达GTC 2026揭秘万亿级“AI工厂”时代

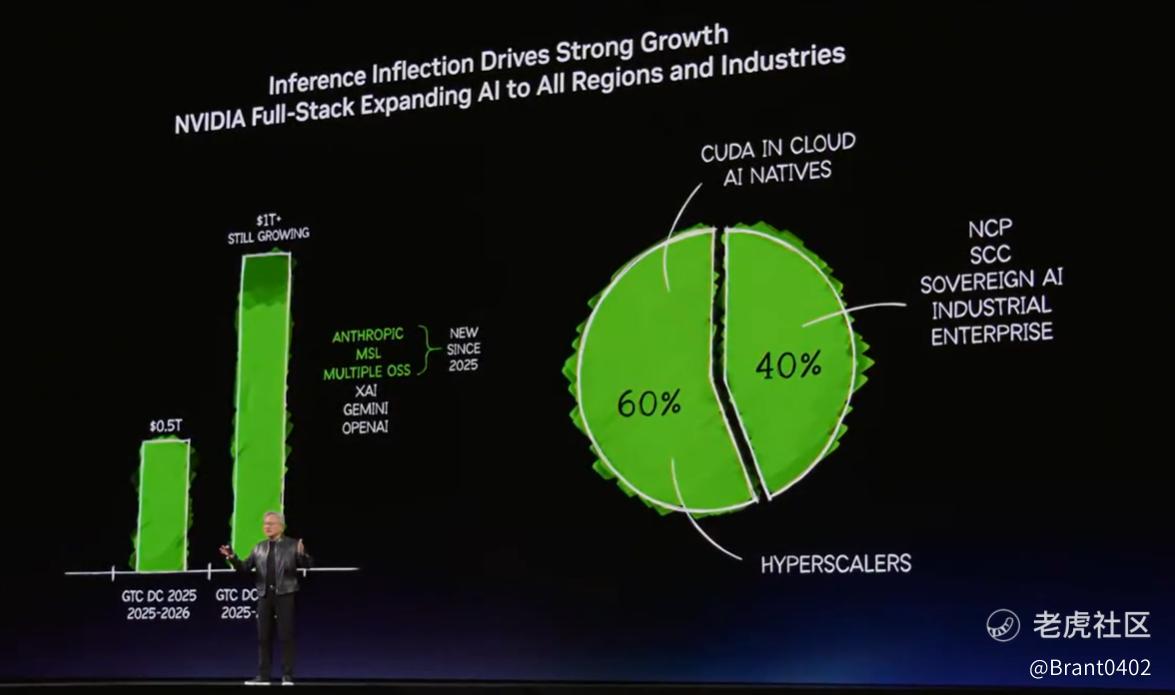

在 $英伟达(NVDA)$ GTC 2026大会上,CEO黄仁勋的演讲正式宣告了AI产业从“训练”向“推理与智能体”的全面范式转移,并预测到2027年,Blackwell和Rubin两代芯片的采购订单将从去年的5000亿美元翻倍至至少1万亿美元。这场盛会不仅确立了英伟达作为AI基础设施领导者的地位,更揭示了计算产业未来十年的底层逻辑。

核心判断一:推理拐点已到,AI计算需求两年增长100万倍。黄仁勋明确宣布:AI不再只是被训练的模型,而是随时随地在推理、在思考、在执行任务。这个拐点,让GPU需求从以亿计变成了以万亿计。

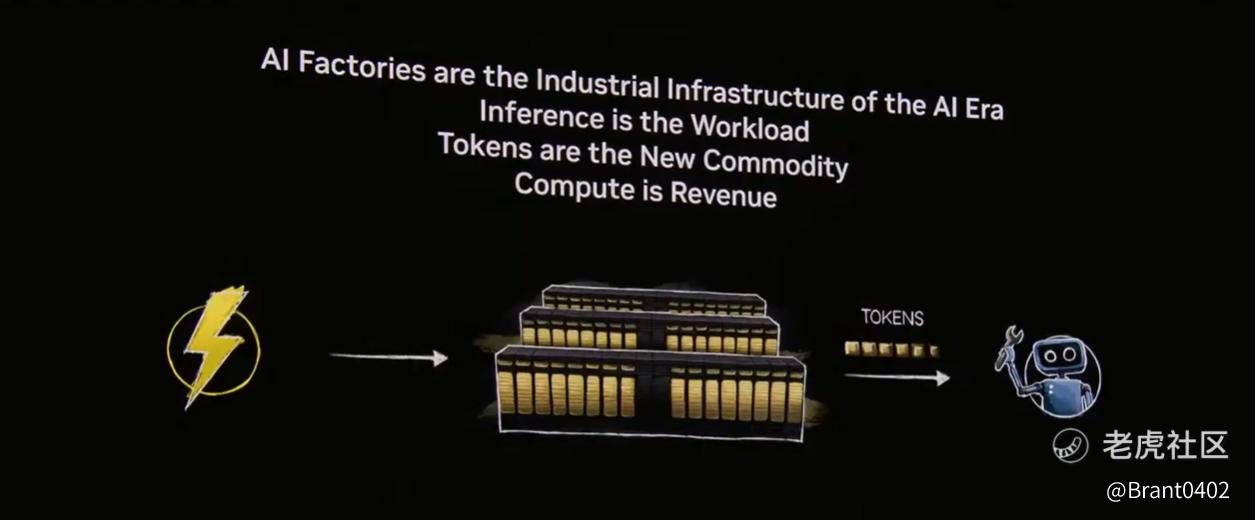

核心判断二:Token是新时代的货币。数据中心不再是存放文件的仓库,而是生产Token的工厂。Token每瓦性能,将成为每一家AI企业最重要的经营指标——这是黄仁勋在GTC上反复强调的全新商业逻辑。

核心判断三:AaaS模式崛起,每一家SaaS公司都将被迫转型。OpenClaw开源Agent操作系统的横空出世,让“智能体即服务”(Agentic as a Service)从概念变为现实。黄仁勋断言:就像当年没有公司能绕开Linux,如今没有公司能回避OpenClaw战略。

核心判断四:物理AI已至,自动驾驶的ChatGPT时刻正式到来。比亚迪、吉利、现代、日产加入英伟达Robotaxi就绪平台,机器人现场走上舞台,AI正在从云端进入每一辆车、每一台机器。

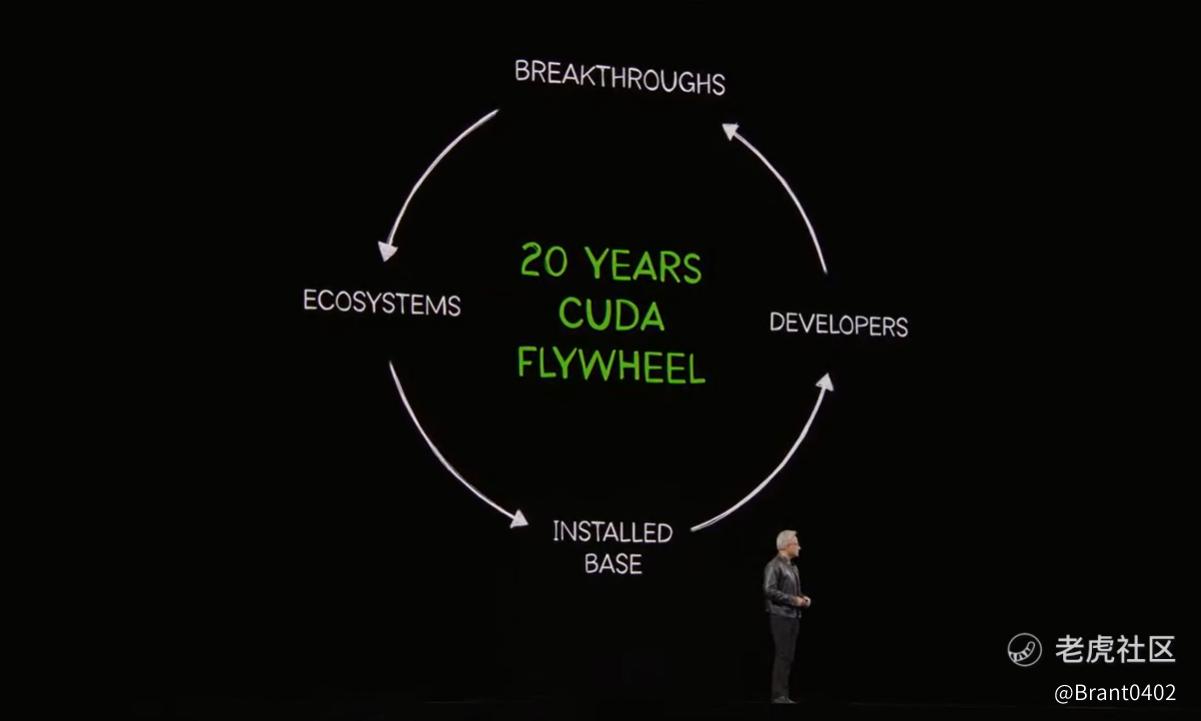

一、CUDA飞轮:20年铸就的护城河

黄仁勋在演讲开场特别强调:这是CUDA诞生的第20周年。

CUDA的逻辑很简单:英伟达建立了庞大的GPU安装基础,安装基础吸引开发者,开发者创造新算法,新算法催生突破性应用,突破性应用吸引更多企业和行业入场,进而扩大安装基础——这是一个自我增强的正向飞轮,而且这个飞轮已经转了整整20年。

目前全球有数亿块运行CUDA的GPU分布在每一朵主流云、每一家计算机公司。上千种工具、编译器、框架和库,数十万个开源公开项目,全部深度绑定在CUDA生态上。PyTorch、TensorFlow等AI框架的底层,都在用英伟达的CUDA。

「CUDA就是AI世界的通用语言。不是唯一选择,却是所有人已经习惯并离不开的选择。换芯片的代价,不是买另一块卡,而是重写所有代码。」

黄仁勋甚至拿六年前发布的Ampere架构做例子:"Ampere的云端定价至今仍在上涨"——因为CUDA生态不断更新,旧硬件也能从新算法中获益。这种"软件持续赋能硬件"的模式,让英伟达的护城河不仅靠芯片性能,更靠生态深度。

竞争对手当然存在:AMD的ROCm、Intel的oneAPI、谷歌的TPU……但20年的先发积累和开发者习惯,使得即便硬件性能相差不多,整个行业也难以轻易迁移。这正是黄仁勋在GTC上最想传递的信息:英伟达不只是在卖芯片,它卖的是一个谁都绕不开的基础设施体系。

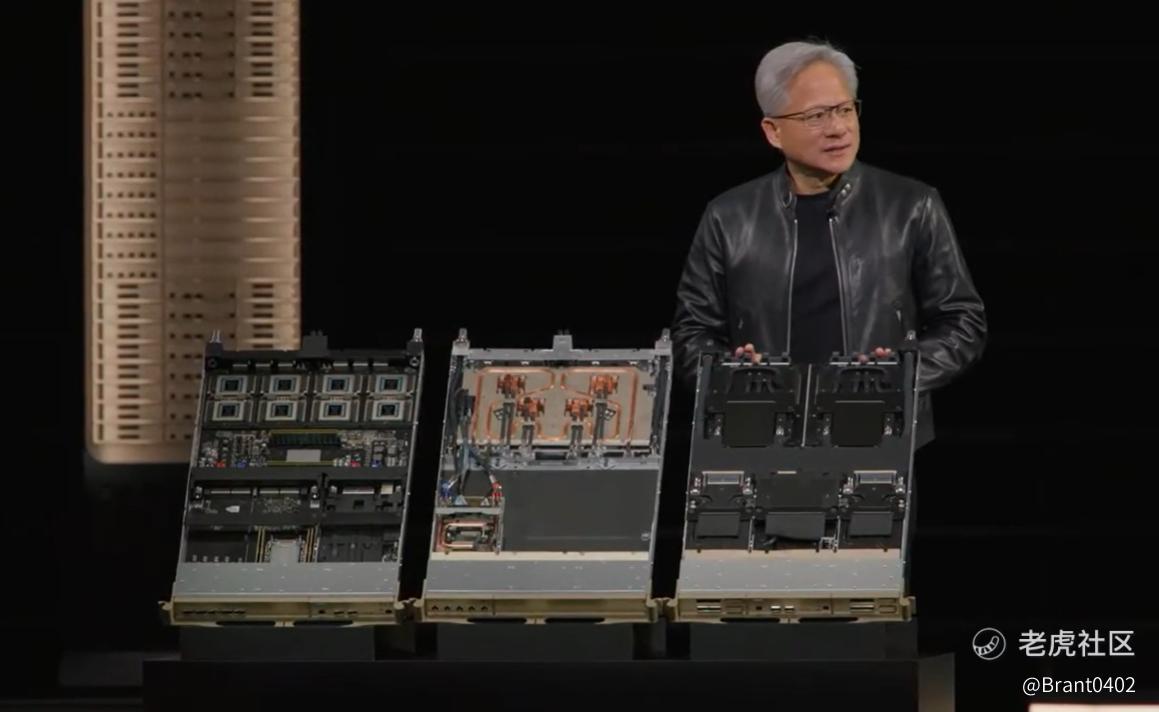

二、Vera Rubin + Groq:算力天花板被再次掀翻

去年GTC上,黄仁勋拿出Grace Blackwell NVLink-72,宣称Token每瓦性能比前代提升35倍——业界都认为他在吹牛。后来半导体分析机构Semi Analysis跑完测试后发了条评论,说黄仁勋"保守了",实际是50倍。

今年,他带来了Vera Rubin。

Vera Rubin NVLink-72拥有3.6 ExaFlops算力,全对全NVLink带宽达260 TB/s。更关键的是,英伟达宣布将以收购Groq团队并授权其技术的方式,将Groq LPU(语言处理单元)整合进Vera Rubin体系。

Vera Rubin + Groq联合部署:最有价值推理层的性能,相比Blackwell再提升35倍。一个1GW的AI工厂,换上Vera Rubin后,可产生的营收是Blackwell时代的5倍。

Groq LPX机架预计2026年Q3出货,由三星代工。Rubin Ultra和下一代Feynman也已在路线图上。

对于AI工厂的运营者,黄仁勋提出了一个新的思维框架:把数据中心看作一个Token工厂。Token是新时代的大宗商品,而Token每瓦性能,就是这座工厂的产能效率指标。在电力约束固定的情况下,谁的Token每瓦更高,谁就能在相同投入下产生更多收入——这正是英伟达反复强调"总拥有成本最低"的底层逻辑。

三、推理拐点:AI从"会说话"到"会干活"

黄仁勋花了大篇幅解释过去两年AI需求爆炸的底层原因,核心逻辑是三次关键跃迁:

第一跳:ChatGPT开启了生成式AI时代,AI从"信息检索机器"变成了"内容生成引擎",计算需求开始急剧扩大。

第二跳:o1等推理模型出现,AI开始"思考"——用链式推理、反复迭代来处理复杂问题。每次思考都需要大量推理计算,输入和输出Token量都显著增加。

第三跳:以Claude Code为代表的Agentic模型出现,AI从"回答问题"进化为"执行任务"。它可以读文件、写代码、编译测试、迭代优化,将AI带入"真正干活"的阶段。

黄仁勋的判断:过去两年,AI计算需求已经增长了100万倍。推理拐点已经到来——AI每次需要思考、行动、生成Token,都需要推理。训练的时代已经过去,推理才是现在和未来的主战场。

这个判断直接解释了为什么GPU需求一路飙升却依然供不应求:不只是在训练更大的模型,而是AI需要在7×24小时不停地推理、不停地响应用户、不停地执行任务。每一次对话、每一次Agent的行动,都在消耗推理算力。

2025年是英伟达的"推理年",他们将NVLink-72、NVFP4、Dynamo(AI工厂操作系统)等一系列技术整合,将同一套硬件上的推理Token速度提升了7倍,这直接转化为AI服务商的收入增长。

四、OpenClaw:AI时代的"新操作系统"

在本次GTC最出人意料的环节里,黄仁勋花了相当篇幅介绍一个刚刚爆红的开源项目——OpenClaw。

OpenClaw由开发者Peter Steinberger发布,在短短数周内成为GitHub历史上增长最快的开源项目,下载量超越了Linux三十年的积累。它的本质是一个AI Agent的"操作系统":管理文件系统、调度任务、调用LLM、与外部工具交互、支持多模态IO……用黄仁勋的话说:"我们不再问AI'什么、在哪里、怎么做',我们开始要求它'创建、去做、构建'。"

英伟达的应对策略是推出NemoClaw——一个基于OpenClaw的企业级安全参考设计,集成了策略护栏、隐私路由器和企业安全机制,使Agent能在企业内网中安全运行,同时接入各家SaaS公司的策略引擎。

黄仁勋的预判:每一家SaaS公司,未来都将成为AaaS公司。OpenClaw的出现,就像当年的Linux和HTML,是一个必须认真对待的行业分水岭。

这个判断对企业的影响是显而易见的:未来的IT支出,将不仅仅是买软件、用SaaS,而是按Token消耗付费——员工的Token预算,或许会成为比工资更关键的生产力指标。黄仁勋说,他已经在考虑给英伟达每位工程师发放年度Token预算,金额可能相当于基本工资的50%。

五、物理AI与机器人:自动驾驶的ChatGPT时刻

本届GTC最具视觉冲击力的时刻,是一个名叫Olaf的雪人机器人走上台,与黄仁勋展开对话。这是迪士尼与英伟达联合开发的成果:在Omniverse仿真环境中用Newton物理求解器训练,再部署到真实机器人硬件上——它不是动画,不是遥控,是真正用物理AI驱动的自主机器人。这意味着从工厂机械臂到人形机器人,物理AI的商业化闭环已经开启。

在自动驾驶领域,黄仁勋宣布"自动驾驶的ChatGPT时刻已经到来"。本届GTC上,英伟达宣布四家新的Robotaxi就绪平台合作伙伴:比亚迪、现代、日产、吉利,四家车企每年合计生产1800万辆汽车。加上此前的奔驰、丰田、通用,以及与Uber的城市级Robotaxi网络合作,英伟达的自动驾驶生态版图已覆盖全球主要汽车制造商。

英伟达为物理AI提供了完整的"三台计算机"架构:训练计算机(数据中心GPU集群)、仿真计算机(Omniverse + Isaac Lab + Cosmos世界模型)、以及车载/机器人计算机(Jetson + DRIVE平台)。这套体系使得机器人和自动驾驶汽车可以在虚拟世界中进行近乎无限的强化学习,而无需在真实世界中积累所有危险场景的数据。

六、特斯拉的另一盘棋:自研芯片,摆脱依赖

就在英伟达GTC描绘宏图的同时,特斯拉,正在从英伟达重要客户的身份,悄然转变为其潜在的竞争对手。

马斯克近日在X发文称,特斯拉的Terafab“造芯”项目将在7日内启动。目前,特斯拉正在设计其第五代人工智能芯片(AI5),以推动其自动驾驶愿景。据特斯拉官方介绍,这款目标2027年量产的芯片有望达到现有AI4 50倍的性能。AI5内存容量是AI4的9倍、原始计算能力是AI4的10倍,将应用于特斯拉从电动汽车到机器人再到AI训练以及数据中心的广泛场景。

马斯克的新战略:all in AI5和AI6推理芯片,同时用两代推理芯片的组合形成"Dojo 3"的训练算力——推理与训练,统一到一颗芯片家族里。

特斯拉选择这条路,背后有更深的战略逻辑:从成本看,特斯拉自研芯片可大幅降低成本;从供应链看,将芯片生产锁定在美国本土,规避关税风险和地缘政治摩擦;从生态看,自研芯片可以根据FSD算法定制优化,做到"软硬件深度融合"。

然而这也带来了新问题:特斯拉选择在AI5用台积电、AI6用三星,在两代芯片之间频繁切换代工厂,供应链管理难度极高。Dojo团队解散后,特斯拉在训练侧的自研算力能否跟上Vera Rubin的节奏,仍有待观察。在大规模Robotaxi落地之前,FSD的训练依然需要持续投入大量外部算力。

结语

英伟达的GTC 2026和特斯拉的芯片战略,表面上指向不同方向,深处却揭示了同一个时代趋势:AI正在从云端的"思维机器",进化为真实世界的"行动主体"。

英伟达在构建整个AI世界的水电煤——算力、网络、软件栈、数据管道——试图让每一家公司、每一台机器都接入它的生态。

特斯拉则在做另一件事:用自研芯片换来供应链独立和成本控制,然后把这套垂直整合的能力,转化为Robotaxi、Optimus和FSD的竞争壁垒。

AI的战争,本质是算力的战争。谁掌握了最高效、最可靠、成本最低的算力,谁就掌握了这个时代最重要的生产资料。

免责声明:上述内容仅代表发帖人个人观点,不构成本平台的任何投资建议。

- TiffanyEveline·03-17 16:50英伟达这波操作,AI市场要起飞了!点赞举报