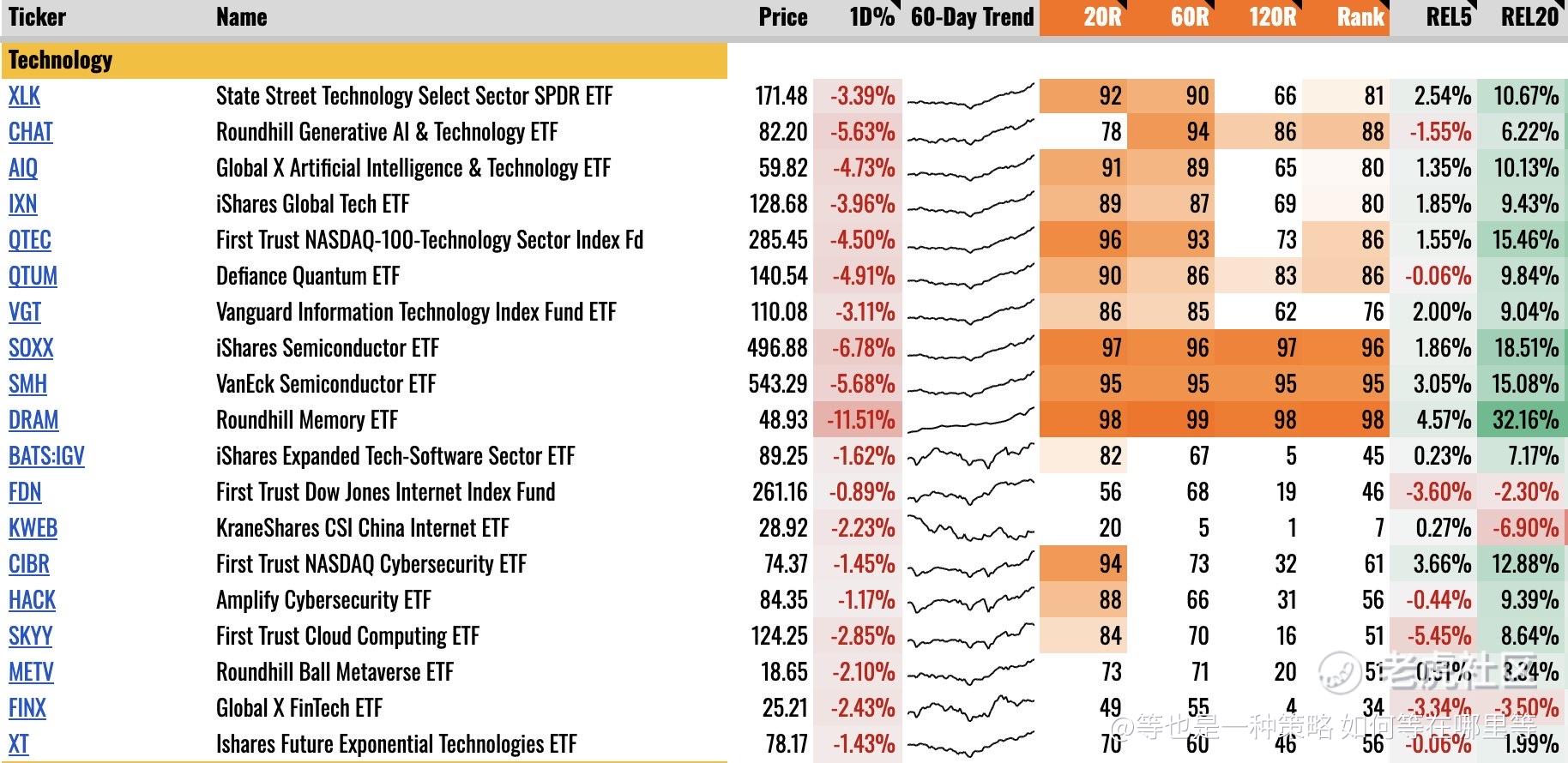

🔥 如果 AI 进入全民推理时代,DRAM 需求可能会超出所有人模型

现在市场几乎所有人都在讨论 GPU、HBM、算力中心。

但真正的问题可能是:

如果未来几十亿设备同时开始运行 AI inference,

整个世界的 memory capacity 够吗?

因为 AI 下一阶段的瓶颈,可能不再只是 compute。

而是 memory。

而且不是单一 memory。

而是完整的 memory hierarchy。

The Five Layers of Memory

Near Memory:

最靠近 GPU 的 memory layer。

核心是超高带宽。

SK hynix

Samsung

$MU

这一层目前几乎由 HBM 主导。

因为 GPU 再强,如果 memory bandwidth 跟不上,算力也无法真正释放。

Main Memory:

很多人可能还没意识到,这层未来的重要性正在快速上升。

SK hynix

Samsung

CMXT

$MU

当 AI 从训练进入全民 inference 时代之后,系统需要的开始不只是速度。

而是巨大的 DRAM capacity。

未来无论是 AI PC、AI 手机、企业 Copilot、Agent、机器人、自动驾驶、边缘 AI,背后都会不断推高 memory usage。

GPU 越强,越需要更大的 memory pool 去喂数据。

否则算力会被浪费。

而市场现在可能仍然用“传统周期股”的方式在看 DRAM。

但 AI 可能正在把一部分 DRAM 需求,慢慢转变成 AI infrastructure demand。

Expansion Memory:

当模型越来越大之后,memory 开始进入“扩展能力”竞争。

SK hynix

Samsung

$MU

$ALAB

$MRVL

$MCHP

$RMBS

这一层已经不只是 memory 本身。

而是:

memory 如何连接、同步、扩展、共享。

未来大型 AI cluster 的竞争,很可能会从 GPU 数量竞争,进入 memory fabric 与 interconnect 架构竞争。

这也是为什么越来越多人开始关注:

CXL、memory pooling、high-speed interconnect。

Contexted Memory:

AI 系统真正落地之后,开始越来越依赖 context retrieval。

SK hynix

Samsung

Kioxia

$MU

$WDC

$SNDK

$SIMO

这一层进入 NAND、SSD、controller、storage pipeline 的世界。

因为未来很多 AI 能力,本质上取决于:

能不能快速读取正确的数据。

尤其 RAG、Agent、企业 AI 普及之后,storage latency 与 context access 会越来越关键。

Data Lakes:

很多人低估了 AI 最底层的 infrastructure。

长期数据存储。

$STX

$WDC

$DELL

$NTAP

$P

$HPE

$IBM

因为没有 data lake,就没有 AI。

训练数据、

企业数据库、

向量数据库、

长期知识库、

AI retrieval system,

最终都需要 storage infrastructure。

而 AI 越普及,全球数据量只会继续指数级增长。

真正有意思的地方在于:

现在华尔街仍然习惯把这些公司拆开估值。

但 AI infrastructure 正在越来越像:

一个完整的 memory ecosystem。

GPU 只是入口。

真正长期决定 AI 上限的,

可能是整个 memory stack 能不能跟上。

免责声明:上述内容仅代表发帖人个人观点,不构成本平台的任何投资建议。

存储