🚀Lisa Su点明方向:推理市场将反超训练,$AMD 的机会真的来了,还是市场过度乐观?

“推理(inference)会比训练(training)大得多。”

这是 Lisa Su 的判断。

更关键的是下一步判断:

明年,超过一半的 AI 工作负载,将来自推理。

这不是边际变化,而是结构性转移。

过去两年,市场几乎完全围绕训练展开。

大模型规模不断扩大,训练算力成为核心瓶颈,这也是 $NVDA 被持续重估的基础。

但现在,叙事开始发生变化。

从“训练模型”,转向“运行模型”。

这意味着算力需求的本质发生改变:

从一次性消耗,转向持续、高频、实时调用。

推理需求,本质上更像“基础设施使用”,而不是“项目投资”。

产业链已经开始提前布局。

NVIDIA 收购 Groq,强化推理能力

Google 联合 Marvell Technology 开发定制 ASIC

目标非常清晰:在推理阶段争夺效率优势。

这背后的变化是:

竞争不再只是算力规模,而是算力效率与成本。

在这个框架下,$AMD 被认为可能受益,主要基于两个逻辑。

第一,硬件结构差异。

$AMD 的 GPU 设计更强调:

更高的内存带宽

更大的显存容量

而推理的核心瓶颈往往在数据搬运和延迟,而不是纯算力峰值。

这使得其架构在特定推理场景中具备潜在优势。

第二,CPU 与 GPU 的协同能力。

推理阶段,尤其是 Agentic AI(代理式AI)开始兴起之后,计算结构发生变化。

任务不再是单次调用,而是多步骤流程:

规划

调度

多轮执行

这些环节对 CPU 的依赖显著提升。

而 $AMD 同时拥有 CPU(EPYC)和 GPU(MI 系列),具备打包销售整套算力方案的能力。

这也是市场讨论的一个重要方向:

是否可以通过 CPU + GPU 组合,争夺部分原本属于 $NVDA 的市场份额。

逻辑上成立,但现实中存在一个关键约束:

软件生态。

$NVDA 的核心优势不仅在硬件,而在于 CUDA 及其开发者生态。

这决定了:

即使推理需求增长,也不意味着份额会快速迁移。

因此,真正的关键不在于谁“更强”,而在于结构是否改变竞争规则。

如果推理成为主导:

GPU 的相对重要性会下降

CPU 的角色会提升

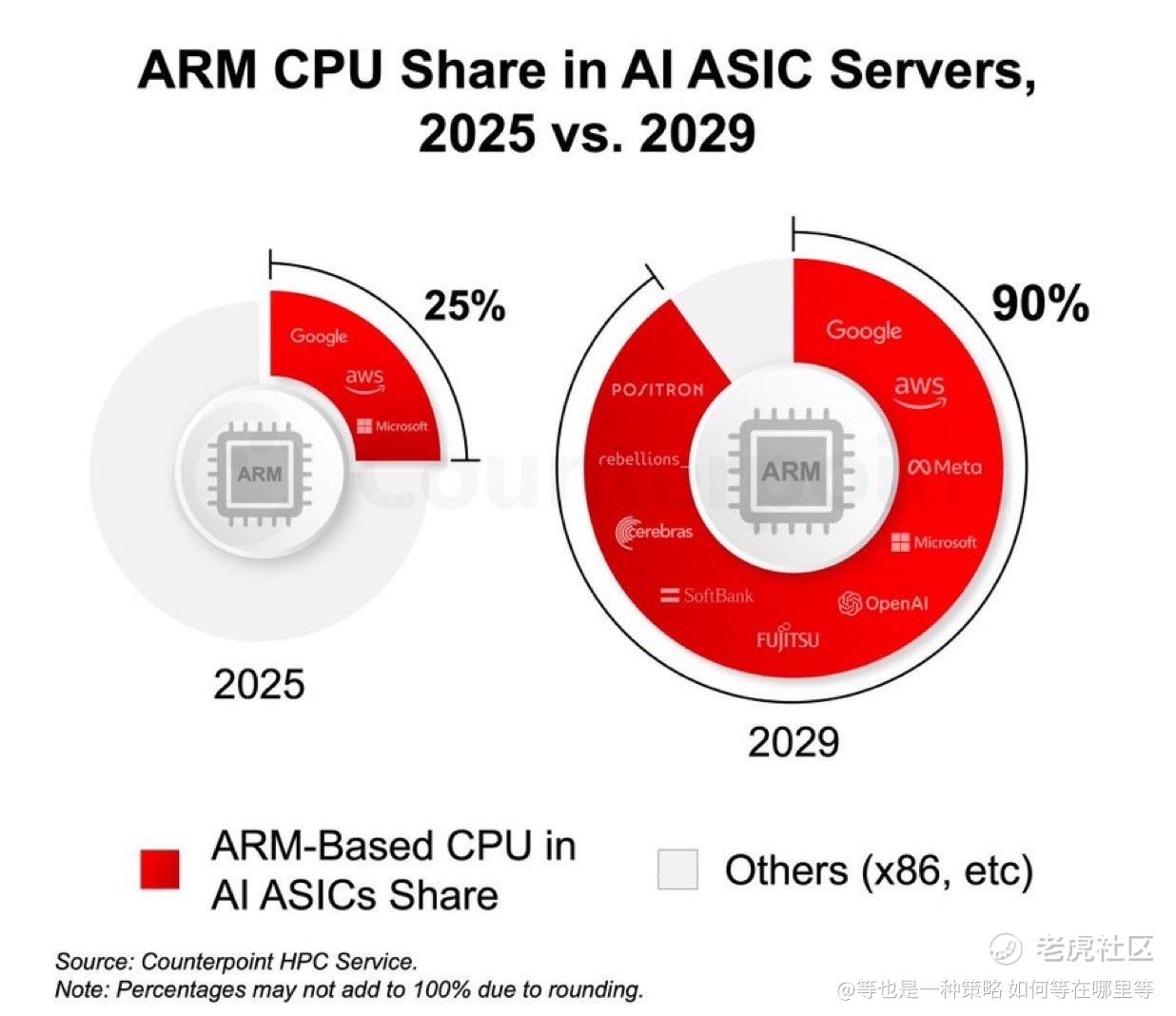

ASIC 会分流部分需求

这为 $AMD 打开空间,但并不自动削弱 $NVDA。

当前市场实际上在提前交易一个命题:

AI 正从训练阶段,进入推理阶段。

问题在于,这个转变是渐进的,还是会加速发生。

如果是渐进变化,竞争格局将缓慢调整。

如果是加速切换,估值体系可能会快速重构。

更关键的问题是:

当推理成为主战场,你更倾向于认为

生态壁垒更重要,还是系统级协同能力更重要?

免责声明:上述内容仅代表发帖人个人观点,不构成本平台的任何投资建议。