过去两年聊AI数据中心,大家的注意力几乎都在GPU:算得快不快、显存够不够、买不买得到。CPU常被当成拖后腿,没弹性的业务。

但如果AI从“会聊天”走向“会干活”——也就是我们说的Agent:能写代码、能上网找资料、能操作各种系统把任务做完,CPU的地位会明显抬升,甚至变成新的瓶颈。

原因很简单:Agent真正耗时间的,往往不是“模型推理答案”,而是“把事办成”的那一串动作。在典型的Agent任务(比如检索资料、执行代码)里,CPU处理时长占比已高达80-90% 。

CPU需求的“天花板”已被彻底打开,从“线性配套”转向了“指数级增长” 。

我们会从两个方面给大家解释清楚,为什么26年要开始重视CPU。

为什么Agent(AI智能体)落地会把CPU“升级成主角”?

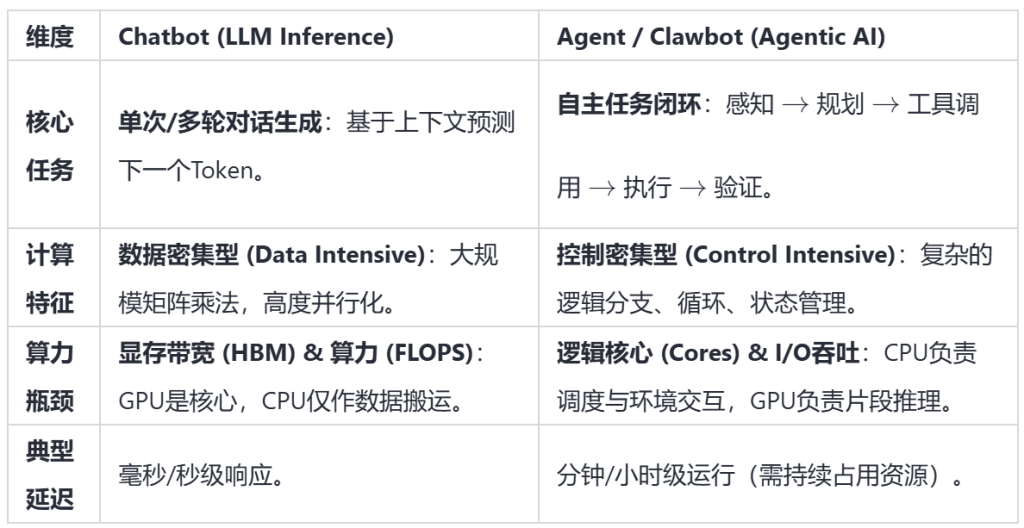

你可以把CPU理解成“总经理”,GPU更像“数学奥赛金牌选手”。Chatbot(元宝、豆包这类聊天机器人)给你的回答是依赖GPU,进行并行矩阵计算得到的。

而Agent(尤其是Clawbot此类执行复杂任务的智能体)引入了大量的逻辑判断、环境交互、工具调用和沙箱管理,这些属于典型的“控制密集型”与“串行计算”任务,从而导致对CPU的算力需求呈现指数级增长。

拿最近爆火的clawbot举例,这个Agent要安全地跑代码、开浏览器,通常得放在隔离环境里(你可以理解成一个个“小隔间”)。128核CPU也只能支撑数百个沙箱,而且一旦并发起来,资源占用可能从个位数瞬间飙到70%以上。更夸张的是,在一些高频企业场景里,“每分钟创建和销毁数万级沙箱”都可能出现,这对CPU的核数和管理能力是硬要求。

Agent不像chatbot,你问一句它答一句,而是“先想怎么做→拆步骤→调用工具→检查结果→不行再来一轮”。

这些步骤里,读写文件、查数据库、调用接口、解压缩、验证结果……大多数都靠CPU。agent把CPU从“服务开销”变成了“工具执行的主力”。

这会带来什么变化呢?——服务器配比要“补课”,CPU王者归来

2024年前很多数据中心偏“重GPU轻CPU”,随着Agent渗透,每兆瓦(MW)GPU算力对应的CPU配比预计将大幅度上升。传统AI服务器是1:4或1:8,而针对Agent优化的架构(如NVIDIA Grace Hopper)采用了1:2甚至更高的CPU配比。

这意味着在GPU数量不变的情况下,CPU的需求量有2倍至4倍的结构性增长空间。甚至有企业开始搭建专门的“工作型CPU集群”,专门完成各种前后处理和工具执行,避免拖累昂贵的GPU。

如果看看CPU的资产,从美国的AMD、英特尔到咱们这边的海光,其实比纯GPU在市值和估值上都是便宜不少的。

最后我小结一下:以Clawbot为例的agent之所以对CPU需求巨大,是因为它本质上是一个“披着AI外皮的操作系统用户”,Agent落地打开了CPU需求的“天花板”。

这不仅是量的修复,更是质的重估。

在2026年的AI版图中,CPU已从“配角”回归舞台中央,半导体行业整体的景气这次不会少了CPU。

风险提示:本文发布的所有内容,不构成任何投资建议,市场有风险,投资需谨慎。

精彩评论